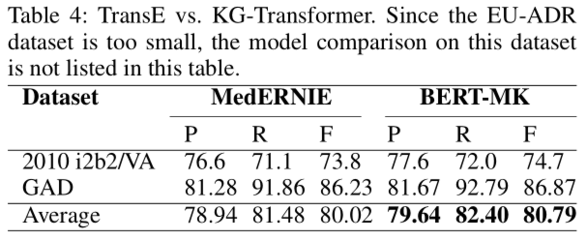

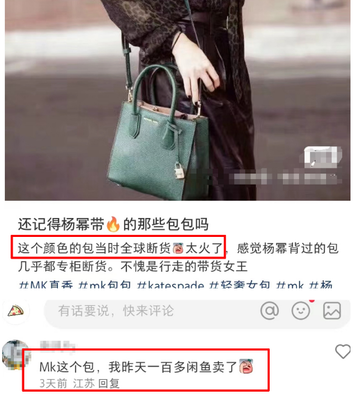

华为诺亚方舟实验室发布了一项突破性的研究成果——一篇题为《基于图上下文知识融入的预训练语言模型》的学术论文,并同步推出了与之配套的MK分析平台。这一创新不仅为自然语言处理(NLP)领域注入了新的活力,也为知识增强型预训练模型的发展指明了方向。

研究背景与核心问题

在传统的预训练语言模型(如BERT、GPT系列)中,模型主要依靠大规模文本语料进行自监督学习,从而捕捉词汇、句法和浅层语义信息。这些模型在处理需要深度理解世界知识、进行复杂逻辑推理的任务时,往往显得力不从心。尽管已有研究尝试将外部知识库(如知识图谱)融入模型,但如何高效、动态地整合结构化的图上下文知识,并使其与文本语义深度融合,仍是一个巨大的挑战。

华为诺亚的这项研究,正是针对这一核心问题展开。论文提出了一种新颖的“图上下文知识融入”(Graph-Contextualized Knowledge Integration, GCKI)框架,旨在让预训练语言模型能够主动吸收并利用知识图谱中的结构化信息,从而提升其在知识密集型任务上的表现。

技术亮点:GCKI框架

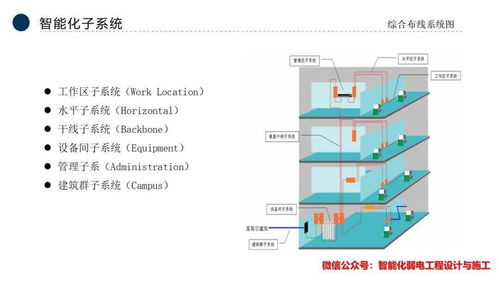

GCKI框架的核心思想是将知识图谱的图结构信息,以“上下文”的形式动态注入到语言模型的预训练过程中。具体而言,该框架包含几个关键模块:

- 图上下文编码器:针对输入文本中提及的实体,从知识图谱中提取其多跳邻居信息,形成一个局部子图。通过图神经网络(GNN)对该子图进行编码,生成富含实体关系与属性的图上下文表示。

- 知识-文本融合模块:这是一个创新的注意力机制层。它并非简单地将图表示与词向量拼接,而是设计了一个双向交互的注意力网络,让文本上下文和图上下文能够相互查询、相互增强,实现知识的深度对齐与融合。

- 多任务预训练目标:为了促使模型真正学会使用图知识,研究团队设计了全新的预训练任务,例如“掩码实体预测”、“关系推理”和“图-文本匹配”等。这些任务迫使模型在理解文本的必须参考图结构信息才能做出正确预测,从而实现了知识的内化。

MK分析平台:从理论到实践的桥梁

与论文配套发布的MK(Model & Knowledge)分析平台,是这项研究成果从实验室走向产业应用的关键一步。该平台具有以下核心功能:

- 可视化知识融合过程:平台允许用户上传文本和指定的知识图谱,动态展示GCKI模型如何提取图上下文、如何进行知识-文本融合。这极大地增强了模型的可解释性。

- 多维度性能评测:平台内置了多种知识驱动的NLP评测基准(如知识问答、事实验证、实体链接等),用户可以直观对比融入知识前后的模型性能差异,量化知识融入带来的增益。

- 定制化知识注入:用户可以根据自身垂直领域(如金融、医疗、法律),导入专属的知识图谱,利用平台工具快速训练或微调出领域专属的知识增强模型,降低了技术应用门槛。

- 分析与诊断工具:平台提供丰富的诊断工具,帮助研究人员分析模型在哪些类型的知识上存在瓶颈,从而指导后续的模型优化与知识库构建。

意义与展望

华为诺亚的这项研究,其意义远不止于提出一个新的模型架构。它代表了一种范式转变:从让模型“被动记忆”知识,转向让模型“主动理解并运用”结构化知识。MK分析平台的推出,则标志着知识增强NLP技术开始进入工具化、平民化的新阶段。

随着知识图谱技术的不断成熟和各行各业数字化进程的深入,能够深度融合知识与语义的预训练模型,将成为下一代人工智能系统的基石。华为诺亚的GCKI框架与MK平台,无疑为这条道路提供了重要的技术储备与实用化工具,有望在智能搜索、精准推荐、行业决策支持、智能客服等多个关键场景中,催生更智能、更可靠的应用解决方案,推动人工智能向更高层次的认知智能迈进。